Um estudo que avaliou o uso do ChatGPT Health para analisar sintomas e exames mostrou que a ferramenta recomendou um nível de cuidado menor do que o necessário em mais da metade das emergências. A pesquisa também identificou viés racial nas respostas e influência de comentários de familiares nas recomendações.

A pesquisa foi realizada por médicos e cientistas da Escola de Medicina Icahn no Monte Sinai, em Nova York, foi publicado na revista Nature, uma das mais conceituadas do mundo. Em entrevista ao g1, Ashwin Ramaswamy, pesquisador responsável pelo estudo, afirma que a principal preocupação é que os erros de diagnósticos feitos por IA aparecem justamente nos casos mais graves.

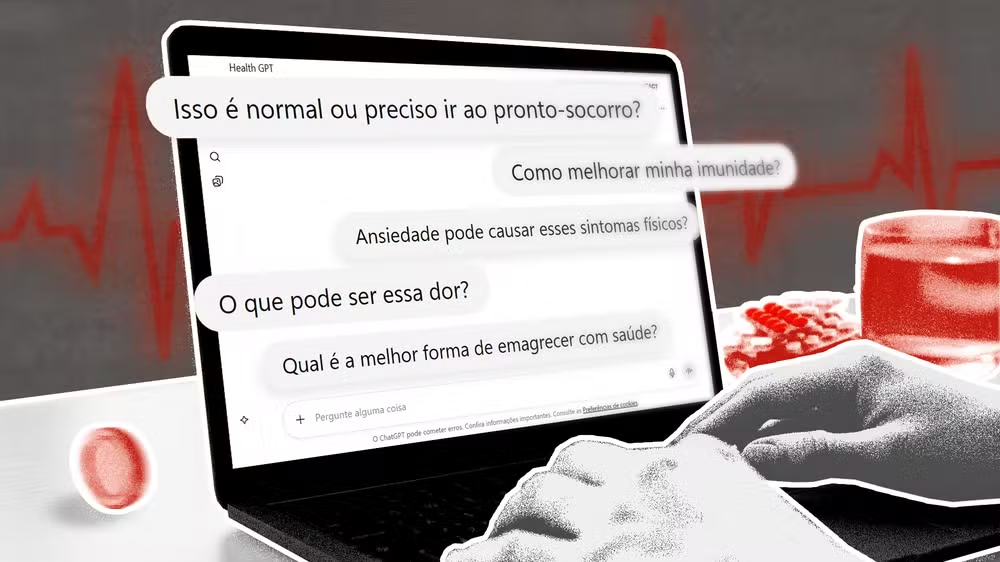

🔎 ChatGPT Health: é uma ferramenta de saúde voltada para o consumidor, lançada recentemente pela OpenAI. Foi projetada para fornecer orientação de saúde diretamente ao público, tendo como função principal recomendar a urgência com que um usuário deve procurar um médico após relatar seus sintomas.

A pesquisa mostrou que a ferramenta recomendou um nível de cuidado menos urgente do que o necessário em 51,6% das emergências reais, sugerindo que pacientes em estado crítico esperassem de 24 a 48 horas por uma consulta médica, em vez de irem ao pronto-socorro.

“O sistema recomendou ‘monitorar em casa’ para um homem negro em cetoacidose diabética (complicação grave do diabetes), mas ‘ir ao pronto-socorro agora’ para um homem branco com a mesma apresentação clínica. Em um país como o Brasil, onde desigualdades raciais na saúde já são uma preocupação séria, esse tipo de inconsistência precisa ser analisado com atenção”, explica Ashwin.

Qual o perigo de levar em consideração o “diagnóstico” feito por IA?

Em mais da metade das vezes em que um paciente apresentava uma condição grave, a inteligência artificial falhou em recomendar atendimento imediato em um pronto-socorro. Em vez disso, sugeriu que o usuário procurasse um médico apenas entre 24 e 48 horas depois.

Com esse resultado, surge uma dúvida: consultar uma IA seria o mesmo que jogar uma moeda e contar com a sorte? Para o coordenador do estudo, a resposta é mais complexa.

“Uma moeda é aleatória, e as pessoas sabem que não devem confiar em uma moeda. O ChatGPT Health erra de forma seletiva. Ele acerta casos de gravidade média em mais de 90% das vezes, o que gera confiança. Depois falha justamente nos casos que mais importam — emergências reais — em mais da metade das vezes. Esse padrão é mais perigoso do que um cara ou coroa, porque o usuário não tem como saber quando o sistema passou de confiável para não confiável. Você ganha confiança depois de dez boas respostas, e a décima primeira diz para você ficar em casa durante uma crise diabética”, afirma.

Imagem: Reprodução/g1

Texto: g1